Los riesgos y oportunidades en el uso de la tecnología deepfakes

Lo que en un inicio se vio como una forma creativa de realizar contenidos para redes sociales, hoy puede ser un grave problema de seguridad: deepfakes.

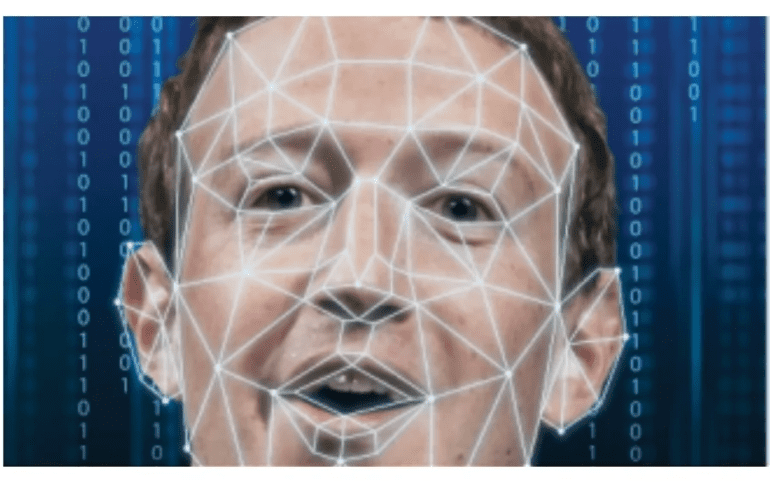

Seguramente has visto algún contenido deepfakes en redes sociales y ni siquiera te has dado cuenta. Se le denomina deepfakes, o falsificaciones profundas en español, a fotos, audios, videos y otras falsificaciones muy realistas generadas con Inteligencia Artificial.

El término deepfakes surgió por primera vez en 2017, pero con el paso de los años ha cobrado mayor relevancia, sobre todo en las redes sociales, donde se difunde todo tipo de contenido sin ser verificado.

Lo que en un inicio se vio como una forma creativa de realizar contenidos atractivos para redes sociales, hoy puede ser un grave problema que se nos puede salir de las manos. Por ejemplo, el Congreso de Estados Unidos considera que estas falsificaciones “podrían presentar una variedad de desafíos de seguridad nacional en los próximos años”.

Y es que la tecnología deepfakes puede ser usada para malas prácticas, como la desinformación, manipulación de elecciones y de la opinión pública, difusión de teorías de la conspiración, noticias falsas, suplantación de identidad y estafas.

Un ejemplo real se dio en marzo de 2022, cuando el presidente ucraniano, Volodimir Zelenski, anunció que un video publicado en las redes sociales, en el que parecía ordenar a los soldados ucranianos que se rindieran a las fuerzas rusas, era una deepfakes.

Bajo este contexto, en México la diputada federal Sayonara Vargas presentó en julio de este año una iniciativa para castigar con penas de tres a seis años de prisión a quien altere imágenes con Inteligencia Artificial (IA) y vulnere la integridad de las personas, principalmente de las mujeres, bajo la práctica de deepfakes.

No obstante, no todo es malo con en uso de la tecnología deepfakes, pues también se han utilizado con fines benéficos, por ejemplo, los investigadores médicos han informado que usan esta Inteligencia Artificial para sintetizar imágenes médicas falsas para entrenar algoritmos de detección de enfermedades raras y minimizar las preocupaciones de privacidad del paciente…

Tal vez, en este punto de la historia es importante preguntarnos: ¿Las personas estamos preparadas para manejar la Inteligencia Artificial? ¿El problema es la tecnología o el uso que le damos las personas?

Empresa creadora de ChatGPT abre oficina en Dublín